机器人终于可以“看人类视频学技能”,枢途科技入选 CVPR 2026

在具身智能加速迈向真实世界的当下,数据系统能力正成为决定机器人能力上限的核心变量。

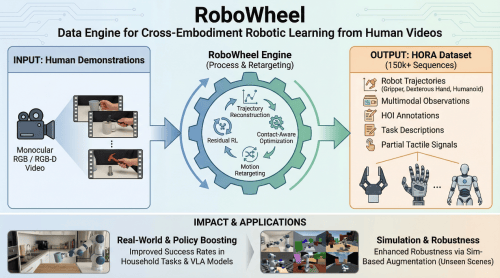

近日,枢途科技宣布,其联合清华大学、香港中文大学等机构完成的最新研究成果――《RoboWheel: A Data Engine from Real-World Human Demonstrations for Cross-Embodiment Robotic Learning》已被CVPR 2026正式录用。该研究提出了一种端到端数据引擎,使机器人能够直接从真实世界的人类操作视频中学习,为具身智能的数据获取路径提供了全新范式。

打进顶会,验证具身数据路线可行性

作为计算机视觉领域最具影响力的国际会议之一,CVPR长期代表着全球学术与产业技术前沿。其论文评审标准严苛,录用率较低。

此次RoboWheel入选CVPR 2026,意味着枢途科技围绕“人类操作视频转具身数据”的技术路径,首次在国际顶级学术体系中获得验证。这也从侧面印证了,其在具身智能数据基础设施方向的技术积累已进入全球前沿梯队。

直击行业痛点:让物理合理的人机交互数据成为可扩展“燃料”

在具身智能走向真实世界落地的过程中,行业面临的核心挑战之一是:机器人数据的获取成本极高,且天然存在异构性。不同的机器人本体、灵巧手、机械臂以及多变的场景,导致各家企业形成了严重的数据孤岛。

针对这一难题,RoboWheel 创新性地将 HOI(Human hand-Object Interaction,人手-物体交互)作为一个更通用的中间层。通过接入真实录制、在线视频和公开数据集等广泛的人类演示来源,RoboWheel 能够将其转化为物理合理、可跨本体迁移的交互数据。这一端到端的数据引擎,让机器人直接从真实世界的人类操作中学习成为可能,为具身智能基础模型提供了持续、低成本且可泛化的数据“燃料”。

同步开源 HORA 数据集,推进产业基础设施化

基于 RoboWheel 构建的数据引擎,枢途科技研发团队同步开源了业界首个从真实场景人类视频中提取的具身多模态训练数据资源――HORA (Hand-Object to Robot Action)数据集。凭借极高的行业价值,HORA 近日已成功入选 EAI-100 具身智能年度十大数据集。

该数据集包含超过 15 万条高质量操作轨迹,实现了毫米级超高精度,并突破性地融合了高精度触觉信号。它将自采数据、动作捕捉数据和已有公开 HOI 数据统一到了一套专为机器人学习设计的数据表示中。

从“做数据”到“做基础设施”

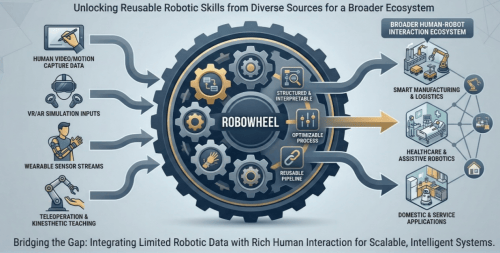

枢途科技的路径并非单一数据提供,而是指向更上游的定位――具身智能数据基础设施提供商。

其核心逻辑是用视频扩展数据供给、用中间层打破本体隔离、用工具链实现规模化生产,这一模式,使其有机会在具身智能产业链中占据“底层入口”。

随着具身智能从实验室走向真实场景,数据正在成为新的生产要素。

RoboWheel的提出,标志着机器人训练数据获取方式的一次重要转向――从“机器采集数据”,走向“人类提供数据”。

未来,随着数据规模与质量的持续提升,具身智能的落地速度有望进一步加快。

【免责声明】【广告】本文仅代表作者本人观点,与和讯网无关。和讯网站对文中陈述、观点判断保持中立,不对所包含内容的准确性、可靠性或完整性提供任何明示或暗示的保证。请读者仅作参考,并请自行承担全部责任。邮箱: